Norsk LLM Hosting

Norsk «ChatGPT» for dine sensitive data.

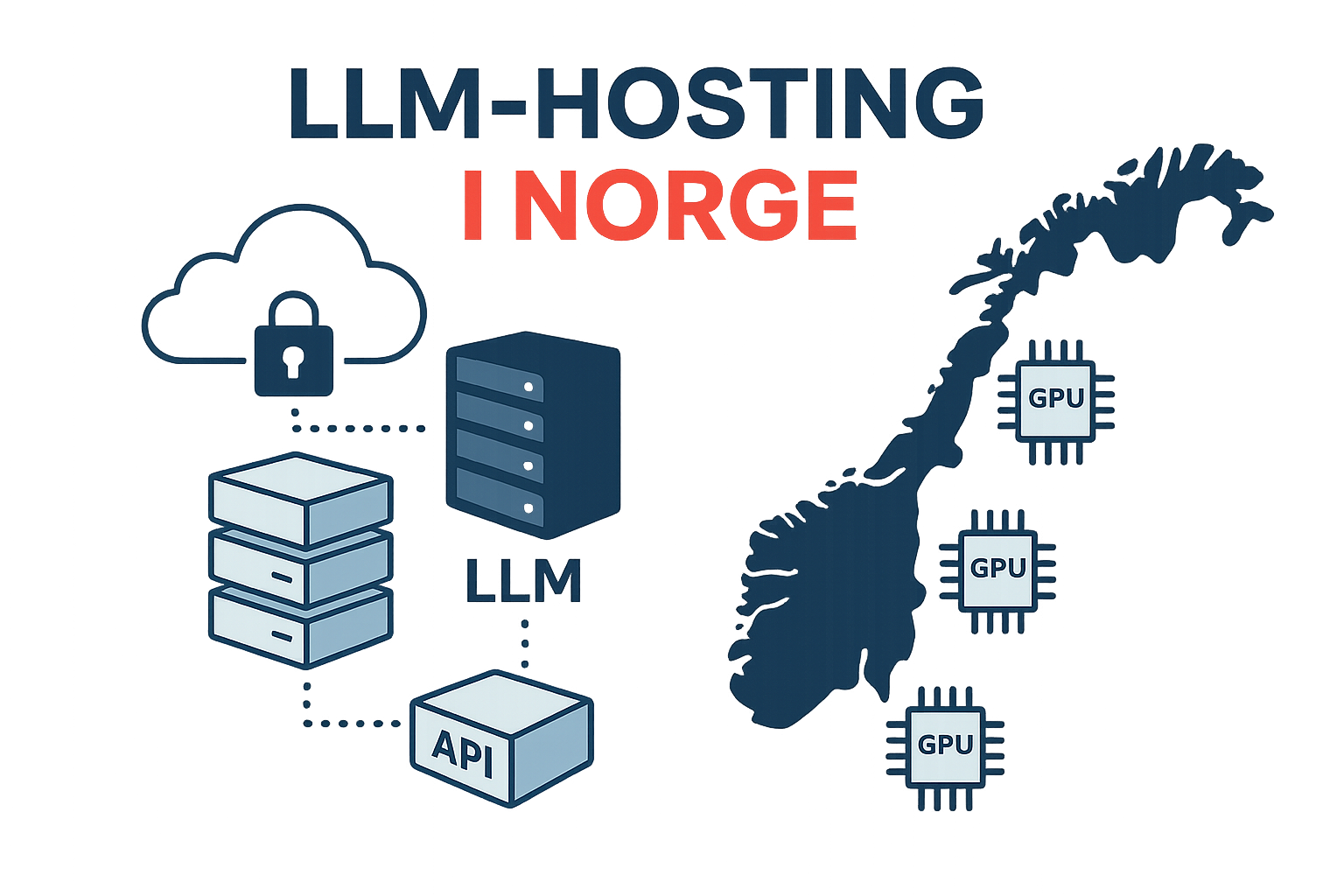

Kjør «open-source» Large Language Models i norske datasentre, med full kontroll over ytelse, datalagring og kostnader. Plattformen vår for LLM-hosting er bygget på våre høytytende skytjenere og GPU-infrastruktur, og gir deg forutsigbar responstid, sterk databeskyttelse og full API-basert automatisering.

Bruk et llama.cpp-kompatibelt API-endepunkt for å levere et bredt spekter av åpne modeller, samtidig som du beholder dataene dine i Norge og innenfor ditt eget styrings- og compliance-rammeverk.

| Dataresidens i Norge | LLM-er kjører i norske datasentre og støtter NIS2-tilpasset sikkerhet og lokale etterlevelseskrav. |

| llama.cpp-kompatibelt API | Bruk et velkjent HTTP-API for å kjøre åpne modeller, integrere med eksisterende applikasjoner og rulle ut nye tjenester raskt. |

| Støtte for åpne modeller | Kjør populære åpne kildekode-baserte LLM-er (f.eks. Llama, OpenAI OSS, Mistral og andre modeller fra det åpne AI-økosystemet). |

| GPU-optimized GPU-optimalisert infrastruktur | Utnytt dedikerte GPU-ressurser for høy gjennomstrømming i inferens og lav responstid. |

| Full automatisering | Klargjør, skaler og overvåk modeller via API-er og managed services, integrert med dine eksisterende DevOps-arbeidsflyter. |